Didaktik: Unterschied zwischen den Versionen

(→Anforderungen definieren, Prüfung gestalten) |

(→Weiterführende Informationen) |

||

| Zeile 93: | Zeile 93: | ||

* [[Technik und Systeme]] | * [[Technik und Systeme]] | ||

* [[Funktionsumfang ausgewählter E-Prüfungssysteme|Vergleich verschiedener E-Prüfungssysteme]] | * [[Funktionsumfang ausgewählter E-Prüfungssysteme|Vergleich verschiedener E-Prüfungssysteme]] | ||

| + | * [http://doodle.com/4npfdn8ziikbyt5k An Hochschulen eingesetzte Systeme (ZKI-Umfrage)] | ||

== Literaturnachweise == | == Literaturnachweise == | ||

Version vom 21. März 2011, 10:25 Uhr

Inhaltsverzeichnis

Einsatzentscheidungen

Einsatzszenario auswählen

Zunächst sind Zweck und Ziele einer elektronischen Prüfung zu bestimmen. Denkbare Einsatzgebiete sind z.B.:

- Studienorientierung und Studienberatung: Orientierung geben, typische Fragen und Probleme des gewünschten Fachgebiets präsentieren und erproben, Stärken und Schwächen von Kandidaten ermitteln, Empfehlungen für Studiengänge erteilen

- Zulassungs- und Einstufungstests: Geeignete Kandidaten auswählen, Vorhandensein notwendigen Vorwissens oder von Vorleistungen sicherstellen, passende Kurse bestimmen, um Studierende nicht zu über- oder unterfordern

- Vor- und Nachbereitung von Lehrveranstaltungen: Lehrveranstaltungen an Vorwissen anpassen, Zeitmanagement optimieren, Feedback zum Verständnis der Inhalte im Anschluss einholen

- Clicker & Audience Response Systems: Wissen, Stimmungen und Meinungen bereits innerhalb einer Lehrveranstaltung abfragen, direkte Reaktionsmöglichkeit, Anregen von Diskussionen zum jeweils aktuellen Thema

- Gemeinsames Lernen: Unterstützen gemeinsamen Lernens, Zuteilung individueller Aufgaben, Förderung der Diskussion zum Lösungsweg, individuelle Anwendung auf eigene Aufgaben

- Quizzes & Zwischentests: Wiederholung von Inhalten, weiteren Aufnahmekanal zur Verfügung stellen, Feedback zum Verständnis geben

- Vorher/Nachher-Prüfungen: Kenntnisse bzw. Leistungen vor und nach dem Lernprozess vergleichen, um neben dem Stand des Prüflings auch den konkreten Lernerfolg des Lernprozesses zu bestimmen

- Elektronische Klausuren: Bewertung des Lernerfolgs im Anschluss an einen Lernprozess, Benotung von Leistungen

- Distanzprüfungen: Durchführen von Prüfungen und Bewerten von Leistungen auf Distanz

- Elektronische Lehrevaluationen: Ermitteln der Zufriedenheit mit Lehrveranstaltungen, Erheben von Verbesserungsvorschlägen, Qualitätssicherung

- Elektronische Klausurschränke: Vorbereitung auf Prüfungen, Sammeln typischer Fragen mit Lösungen, kein Zugriff für Lehrende

- Progresstests: Ermitteln des Lernfortschritts im Rahmen einer kompletten Ausbildung durch regelmäßige Erhebungen

In der Abbildung (rechts) sind diese verschiedene Szenarien eingeordnet in eine Matrix nach Relevanz für den Studienverlauf und der Notwendigkeit nach Überwachung. So ist eine benotete E-Klausur (oben rechts) z.B. sehr relevant für den weiteren Studienverlauf, da ein Scheitern daran ein Studium im schlimmsten Fall beenden kann. Aus diesem Grund finden E-Klausuren i.d.R. in überwachter Umgebung statt. Quizzes oder Zwischentests (unten links) hingegen sind kaum relevant für den Studienverlauf. Studierende können sie beliebig oft durchführen, z.B. bis sie das Thema verstanden haben. Eine Aufsicht ist dazu nicht nötig. Es scheint eine gute Idee zu sein, für den Einstieg in E-Prüfungen nicht direkt mit "gefährlichen" Szenarien zu beginnen, sondern ungefährlichere auszuwählen. Lehrende können auf diese Weise leicht den Umgang mit den neu eingesetzten Technologien lernen und deren Zuverlässigkeit erproben.

Ist die Entscheidung für ein bestimmtes Szenario gefallen, ist im nächsten Schritt eine geeignete Metapher zu bestimmen, welche die Verwendung elektronischer Verfahren erleichtert. Soll z.B. eine bereits schriftlich vorliegende Version lediglich "elektronisiert" werden, damit diese die Lernenden auch auf anderen Kanälen als bisher erreichen kann? Oder sollen ganz neue Wege gegangen werden, die z.B. multimediale Elemente einbeziehen, die in der traditionellen schriftlichen Form nicht einbezogen werden konnten?

Eine detaillierte Beschreibung verschiedener Möglichkeiten mit zugehörigen Praxisbeispielen findet sich in der Übersicht über verschiedene Einsatzszenarien. Eine Übersicht über die Experten zu den einzelnen Szenarien und dafür eingesetzte Technologien findet sich in der Kompetenzmatrix.

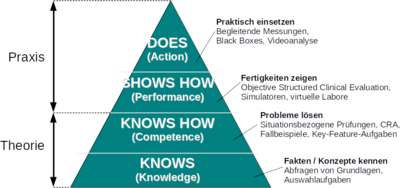

Professionalisierungsebene bestimmen

Abhängig davon, wie weit ein Lernender auf dem Weg vom Anfänger zum Experten fortgeschritten ist, stehen unterschiedliche Möglichkeiten zur elektronischen Leistungsmessung zur Verfügung. Es gilt nun, die jeweilige Ebene der Kompetenzentwicklung zu identifizieren und zugehörige passende Verfahren auszuwählen.

- Wissen: Lernende kennen die Grundlagen des jeweiligen Fachgebiets, angemessene Prüfungen benutzen zur Ermittlung des Wissensstandes z.B. Multiple-Choice-Aufgaben.

- Kompetenz: Lernende können mit Hilfe ihres Grundlagenwissens typische Probleme lösen. Angemessene Prüfungen konfrontieren Lernende mit neuen Situationen oder Fallbeispielen, deren Probleme sie mit ihrem Wissen lösen sollen.

- Leistung: Lernende zeigen praktische Abläufe, ohne diese jedoch in der regulären Praxis einzusetzen. Möglichkeiten, um das elektronisch zu überprüfen, bieten z.B. virtuelle Labore, Simulatoren oder Operationen an virtuellen Patienten.

- Handlung: Lernende setzen ihre Fertigkeiten in der Praxis ein. Entsprechendes Verhalten kann z.B. durch Black Boxes, Videoanalysen oder der Tätigkeit angepasste Aufzeichnungsmethoden festgehalten und analysiert werden.

Ein Prüfender wählt denjenigen Typ Prüfung aus, der dem jeweiligen Professionalisierungsgrad der Lernenden entspricht. Abhängig davon, wie praxisorientiert eine Hochschule ihre Studierenden ausbildet, sind somit verschiedene Möglichkeiten elektronischer Leistungsmessung denkbar. Das bedeutet aber auch, dass grundlegende Formen wie das Abprüfen von Wissen mittels MC-Fragen für alle Hochschulen in Frage kommen kann.

Anforderungen definieren, Prüfung gestalten

Lehrende sollten sich im Vorfeld überlegen, welche Anforderungen sie an ihre E-Prüfung stellen und wie diese dazu gestaltet sein sollte. Als Grundgerüst für diese Überlegungen sollen nachfolgend die bereits beschriebenen Charakteristika dienen.

- Zweck: Zunächst muss der Lehrende den Zweck einer Leistungsmessung bestimmen. Ist z.B. Sachkompetenz festzustellen, kann es reichen, die Ergebnisse der gestellten Aufgaben zu erfassen und auszuwerten. Bei Methodenkompetenz ist der Lösungsweg zu analysieren, der bei der Bearbeitung der Aufgabe gewählt wird, während bei Sozialkompetenz eher das Verhalten und die Kommunikation der Prüflinge untereinander im Vordergrund steht.

- Art: Summative Prüfungen überprüfen den Lernerfolg im Anschluss an einen Lernprozess, während formative Prüfungen den Lernprozess begleiten und dabei helfen, ihn in eine erfolgreiche Richtung zu lenken. Diagnostische Prüfungen geben eine starre Schablone vor, in die sich die Prüflinge durch ihre Leistungen einordnen, so dass der Prüfende sie vergleichend beurteilen kann. Adaptive Prüfungen hingegen passen Schwierigkeitsgrad und Themen an Prüflinge an, um Fähigkeiten oder Schwachstellen individuell einzugrenzen. Bei prognostischen Prüfungen korreliert das Testergebnis mit dem zu erwartenden Leistungsniveau der Prüflinge; sie finden z.B. als Zulassungstests Anwendung.

- Form: Abhängig von der Professionalisierungsebene: Fakten und Konzepte können z.B. mit Multiple-Choice-Aufgaben getestet werden. Eine Gegenüberstellung, welche Fragetypen sich hier für welche Lernziele anbieten, findet sich z.B. bei Vogt und Schneider[1]. Um die Anwendung von Fakten und damit die Problemlösefähigkeiten der Prüflinge zu testen, bieten sich situationsbezogene Prüfungen oder Fallbeispiele an. Sollen Prüflinge hingegen erlernte Fertigkeiten zeigen, können sie dies z.B. in Simulatoren, virtuellen Laboren oder den OSCEs machen. Schließlich helfen begleitende Messungen, z.B. als Black Boxes, bei der Analyse alltäglicher Abläufe in der Praxis.

- Prüfender: Legt fest, wer die Ergebnisse beurteilen soll. So kann ein Lehrender im Rahmen traditioneller Bewertung (Teacher Assessment) korrekte Antworten vorgeben und so zu einer automatisierten Auswertung beitragen. Sollen sich Prüflinge hingegen selbst einschätzen (Self Assessment), wie es z.B. mit Lernfortschrittskontrollen in reinen E-Learning-Einheiten üblich ist, erscheint es sinnvoll, Lösungswege oder zusätzliche Hinweise als Feedback zu hinterlegen. Eine Auswertung von Eingaben durch andere Prüflinge oder Gruppen (Peer/Group Assessment) setzt zudem Kriterienkataloge voraus, an denen sich diese zur Bewertung orientieren können. Auf diese Weise verschmelzen die Lernenden nach Bogner[2] stärker mit dem Lernprozess, was sich positiv auf den Lernerfolg auswirken kann.

- Ort: Prüfungen auf dem Campus, z.B. in einer Veranstaltung, sind i.d.R. anders gestaltet als Prüfungen, die Prüflinge zu Hause ablegen. Zudem ist von Bedeutung, ob eine Prüfung beaufsichtigt sein muss, weil z.B. Täuschungen erschwert werden sollen, oder ob sie der Übung oder Beschäftigung mit dem Thema dient und an beliebigen Orten abgewickelt werden kann. Feste Prüfungen setzen fest installierte Arbeitsplätze voraus, z.B. ein Testcenter wie es die Uni Bremen einsetzt. Für mobile Prüfungen kann man z.B. einen Hörsaal mit Tablet-PCs oder Clickern ausstatten, auf dem die Teilnehmer ihre Eingaben vornehmen.

- Zeit: Neben dem Ort spielt auch die Zeit eine wesentliche Rolle. Abhängig vom Typ der Prüfung (formativ/summativ) ist zu entscheiden, ob einmalig oder kontinuierlich geprüft werden soll. Auch summative Prüfungen können kontinuierlich erfolgen, z.B. wenn im Rahmen eines Moduls mehrere Klausuren oder Tests vorgesehen sind.

- Bewertung: Die Auswertung von Eingaben kann abhängig von den ausgewählten Fragetypen manuell oder (teil-)automatisiert stattfinden. Eine Beurteilung der Ergebnisse liegt dann im didaktischen Ermessen des Lehrenden, insofern nicht in einer Ordnung oder Moduldeskriptor anders vorgeschrieben. Von traditionellen Formen bin zum „confidence-based marking“ (siehe dazu Gardner-Medwin und Gahan[3]) sind verschiedene Methoden der Bewertung vorstellbar. Im letzteren Fall gibt der Prüfling neben jeder Antwort noch an, wie sicher er sich seiner Antwort ist (von unsicher/geraten bis sehr sicher). Damit sind Rückschlüsse auf das Zutrauen ins eigene Wissen sowie auf Fehler im Lernprozess möglich, die dann z.B. im formativen Fall in den weiteren Lernprozess einfließen können.

- Feedback: Schließlich ist festzulegen, welche Rückmeldung die Prüflinge erhalten sollen. Feedback kann schriftlich erfolgen oder in einem Gespräch mit dem Bewertenden. Darüber hinaus ist zu überlegen, wie detailliert das Feedback sein muss. Die Reichweite reicht von einem „hat bestanden“ bis hin zu einer detaillierten Analyse von Schwachstellen mit einer individuellen Beratung. Ein solches Feedback kann z.B. direkt im Anschluss an die Abgabe oder erst nach abschließender Qualitätskontrolle durch den Lehrenden erfolgen (der dann vielleicht noch den Notenspiegel aufgrund der per Itemanalyse ermittelten Frageschwierigkeiten anpassen kann). Der Lehrende erhält durch die Antworten und statistischen Auswertungen der Eingaben ebenfalls ein Feedback, was besonders gut verstanden wurde und welche Inhalte vielleicht noch einmal aufgegriffen oder wiederholt werden sollten.

Ablauf festlegen

Technologien aussuchen

- siehe Technik und Systeme

Qualitätssicherung

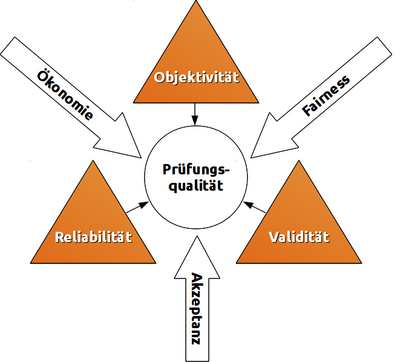

Lienert & Raatz[4] sowie Amelang & Schmidt-Atzert[5] identifizieren verschiedene Gütekriterien eines Tests. Stieler[6] untersucht diese Kriterien für den pädagogischen Bereich, insbesondere zur Gestaltung von Klausuren.

Hauptgütekriterien

Bauen aufeinander auf, wobei jede Stufe ist nur nach Erfüllung der vorhergehenden zu erreichen ist.

- Objektivität: Unabhängigkeit vom Untersucher; verschiedene Prüfer kommen bei gleichen Prüflingen zum gleichen Ergebnis.

- bei Durchführung der Prüfung (Durchführungsobjektivität)

- bei Auswertung der Antworten (Auswertungsobjektivität)

- bei Interpretation der Ergebnisse (Interpretationsobjektivität)

- Reliabilität: Grad der Messgenauigkeit; Wiederholungen erbringen bei gleichen Beteiligten gleiche Ergebnisse.

- durch Paralleltests: streng vergleichbare Tests wiederholen

- durch Retests: gleichen Test wiederholen

- innere Konsistenz: messbar z.B. als Cronbachs Alpha

- durch Testhalbierung: Test in gleichwertige Hälften teilen und als 2 eigene Tests auswerten (siehe Paralleltest)

- durch Konsistenzanalyse: Ermittlung der Reliabilität auf indirektem Weg über Aufgabenschwierigkeit und Trennschärfe

- Validität: Ergebnisse des Tests korrelieren mit den zu prüfenden Kompetenzen.

- Inhaltsvalidität: Test prüft Wissen/Kompetenzen/Leistung, die mit Lehrzielen übereinstimmen.

- Konstruktvalidität Test ist geeignet, inhaltliche Kompetenzen zu erfassen (und nicht z.B. die Fähigkeit des Prüflings, Gedanken in kurzer Zeit aufzuschreiben/einzugeben).

- Kriteriumsvalidität: Testergebnisse stimmen mit empirischem Kriterium überein, das bereits vorliegt (konkurrente Validität, z.B. Schulnoten) oder erst später erkennbar wird (prognostische Validität, z.B. Studienerfolg).

Nebengütekriterien

- Akzeptanz: Test ist für Prüflinge transparent; keine Normen werden verletzt.

- Ökonomie: Nutzen übersteigt Kosten.

- Chancengerechtigkeit/Fairness: Gleiche Voraussetzungen für alle.

Spannungsfeld

Die genannten Kriterien können sich gegenseitig beeinflussen. Ein Beispiel: setzt man genügend Mittel und Zeit ein (Ökonomie), ist es möglich, eine Prüfung sehr objektiv, reliabel und valide zu gestalten. Das erhöht ebenso die Akzeptanz unter den Prüflingen. Sind hingegen hohe Reliabilität und Akzeptanz nicht wichtig, ist eine auch mit geringerem Mitteleinsatz möglich. Diese Faktoren sind jeweils im Einzelfall abzuwägen.

Itemanalyse

Itemanalyse bezeichnet die Verwendung statistischer Verfahren, um die Brauchbarkeit von Aufgaben (den sog. Items) zu beurteilen. Sie versucht deren Reliabilität zu erfassen und ist damit Voraussetzung, diese ggf. zu verbessern. Dies geschieht i.d.R. durch Analyse der Rohwertverteilung, Berechnung statistischer Kennwerte wie Itemschwierigkeit, Trennschärfe und Homogenität sowie durch Dimensionalitätsprüfung. Häufig wird die Itemanalyse mit Antworten einer Referenzgruppe durchgeführt, die der Zielgruppe (als Stichprobe) ähnlich ist.

- Rohwertverteilung: Durch grafische Darstellung der Ergebnisse besteht die Möglichkeit, die Verteilung mit der (gewünschten oder erwarteten) Normalverteilung zu vergleichen

- Itemschwierigkeit: Gibt das Verhältnis der Personen, die dieses Item richtig gelöst haben, zu sämtlichen Testteilnehmern an.

- Trennschärfe: Macht Aussagen über die Vorhersagbarkeit des Gesamtergebnisses aufgrund der Beantwortung des vorliegenden Items.

- Homogenität: Gibt an, wie sehr die unterschiedlichen Items eines Tests miteinander korrelieren, sowohl vom Inhalt als auch von ihrer Schwierigkeit.

- Dimensionalität: Beschreibt, ob ein Test nur ein Merkmal (eindimensionaler Test) oder mehrere Konstrukte bzw. Teil-Konstrukte erfasst (mehrdimensionaler Test).

Weiterführende Informationen

- Verschiedene Aufgabentypen

- Erstellen von Multiple-Choice-Aufgaben

- Organisation und Durchführung elektronischer Prüfungen

- Ansprechpartner und Experten

- Technik und Systeme

- Vergleich verschiedener E-Prüfungssysteme

- An Hochschulen eingesetzte Systeme (ZKI-Umfrage)

Literaturnachweise

- ↑ Michael Vogt, Stefan Schneider: E-Klausuren an Hochschulen: Didaktik – Technik – Systeme – Recht – Praxis, Koordinationsstelle Multimedia, JLU Gießen, 2009, Download als PDF

- ↑ Christian Bogner: Studentisches Feedback im Bachelor - Eine empirische Untersuchung zur Effektivität und Qualität eines angepassten Peer-Assessment-Verfahrens, in A. Back, P. Baumgartner, G. Reinmann et al. (Hrsg): zeitschrift für e-learning - lernkultur und bildungstechnologie, ISSN: 1992-9579, Themenheft E-Assessment, S. 36-49, Studienverlag, Innsbruck, 2010

- ↑ A.R. Gardner-Medwin, M. Gahan: Formative and Summative Confidence-Based Assessment, in: Proceedings of the 7th CAA Conference, S. 147-155, Loughborough University, Loughborough, 2003, Download als PDF (Abgerufen am 15.07.2010)

- ↑ Gustav A. Lienert, Ulrich Raatz: Testaufbau und Testanalyse, 6. Auflage, ISBN-13: 978-3621274241, BeltzPVU, 1998, bei Google Books

- ↑ Manfred Amelang, Lothar Schmidt-Atzert: Psychologische Diagnostik und Intervention, 4. Auflage, ISBN-13: 978-3540284628, Springer, Berlin, 2006, bei Google Books

- ↑ Jona Florian Stieler: Validität summativer Prüfungen - Überlegungen zur Gestaltung von Klausuren, ISBN: 3-938076-36-4, Janus Presse, Bielefeld, 2011, Download als PDF