Elektronische Prüfung

Inhaltsverzeichnis

Begriffsdiskussion

Eine elektronische Prüfung (E-Prüfung) ist eine Prüfung, bei der Informations- und Kommunikationstechnologien (IKT) eingesetzt werden. Diese können bei der Aufgabenstellung, Leistungserbringung sowie Leistungsbeurteilung eingesetzt werden, beziehen sich also auf Vorbereitung, Durchführung und/oder Auswertung der Prüfung. Durch (teil-)automatisierte Auswertung ist effizientes Feedback möglich, das Lernende zur besseren Selbsteinschätzung und Lehrende zur Aufdeckung von Defiziten nutzen können, jeweils mit Möglichkeit zur Nachbesserung.

E-Klausur

Spezialfall einer E-Prüfung ist die elektronische Klausur (E-Klausur), die eine Leistung summativ bewerten bzw. benoten soll. E-Klausuren haben damit eine Relevanz für den weiteren Studienverlauf, da ein Studium nach mehrmaligem Scheitern im schlimmsten Fall beendet sein kann. Aus dem Grund werden besonders hohe Anforderungen an ihre Rechtssicherheit gestellt.

E-Assessment

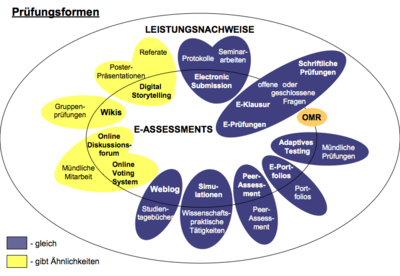

Allgemeiner gehalten ist der Begriff E-Assessment, der generell den Einsatz von IKT bei der Leistungserbringung beschreibt. Darunter fallen elektronische Verfahren, die den klassischen Leistungsnachweisen ebenbürtig sind, z.B. Weblogs anstelle von Studientagebüchern, aber auch der Einsatz elektronischer Werkzeuge zur Simulation typischer Anwendungssituationen wie die Modellierung mathematischer Konstrukte mit MAPLE oder die Eclipse-Plattform für Programmieraufgaben. Eine Einordnung der Begriffe und Gegenüberstellung von elektronischen mit traditionellen Verfahren ist z.B. bei [1] zu finden.

Die elektronischen Prüfungen, von denen hier die Rede ist, sollen im Sinne von Blended Learning eingesetzt werden. Sie sollen klassische Klausuren nicht ablösen (zumindest nicht vorrangig), sondern als weiteres Instrument zur Anreicherung der Hochschullehre zur Verfügung stehen. Damit können sie, insofern didaktisch sinnvoll eingesetzt, siehe u.a. [2], zur Verbesserung der Qualität der Lehre beitragen, wobei die Qualität in diesem Fall z.B. in einer effizienten Auswertung, schnellem Feedback oder einer motivierenden Wirkung auf Studierende gemessen werden kann.

Elektronische Leistungsmessung nach Professionalisierungsgrad

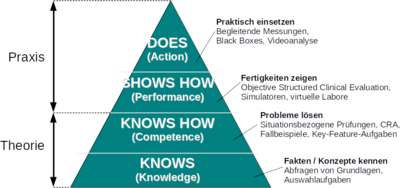

Miller[3] identifiziert vier Ebenen (proficiency levels), die Lernende beim Aufbau von Fertigkeiten durchlaufen. Diese Ebenen bauen jeweils aufeinander auf und repräsentieren den Grad der Professionalisierung eines Lernenden auf dem Weg vom Anfänger zum Experten. Während die unteren Ebenen Theorie und Erkenntnisgewinn (Cognition) beschreiben, repräsentieren die darüber liegenden Ebenen deren Umsetzung in die Praxis (Behaviour). Die elektronische Leistungsmessung richtet sich nach dem Grad der Professionalisierung und muss daher an die jeweilige Ebene angepasst sein.

- Knowledge (Wissen): Grundlage der Professionalisierung ist das Wissen um Fakten und Konzepte. Um deren Verständnis abzufragen, verwenden zugehörige Messungen z.B. Multiple-Choice-Aufgaben. Ein Beispiel ist das Konzept „Rechts vor Links“, dessen Grundlagen bei der Führerscheinprüfung behandelt werden.

- Competence (Problemlösung): Im darauf aufbauenden Schritt kann ein Lernender das vorhandene Faktenwissen zur Problemlösung einsetzen. In diesem Fall sind situationsbezogene Prüfungen oder Fallbeispiele sinnvoll, die eine angemessene Anwendung bereits gelernter Fakten überprüfen können. Beispiel aus der Führerscheinprüfung ist die Darstellung einer Verkehrssituation mit der Frage, was in diesem Fall zu tun ist.

- Performance (Fertigkeiten): Die folgende Ebene umfasst praktische Fertigkeiten eines Lernenden; sie verlässt den reinen Erkenntnisbereich und bezieht sich auf erlerntes Verhalten. Hier geht es darum, Handlungsweisen nicht nur zu beschreiben oder verstanden zu haben, sondern diese gezielt erbringen zu können. Möglichkeiten, um das elektronisch zu überprüfen, bieten z.B. virtuelle Labore oder Simulatoren. So könnte man bei der Führerscheinprüfung z.B. einen Fahrsimulator einsetzen, um die Fahrtüchtigkeit der Prüflinge zu erproben..

- Action (Können): Als Experte wendet der Lernende schließlich Wissen, Problemlösekompetenz und Fertigkeiten in der Praxis an. Durch Beobachtung und Aufzeichnung kann dieses Verhalten bestimmt und analysiert werden. Beispiele sind Fahrtenschreiber in Fahrzeugen, Black Boxes in Flugzeugen oder die Videoanalyse von Bewegungsabläufen bei Sportlern, um Optimierungspotential aufzudecken.

Reine Wissensprüfungen bergen die Gefahr, dass man Prüflingen aufgrund ihres Wissens (träges Wissen) fälschlicherweise Können zuschreibt bzw. umgekehrt vermutet, dass wenn bestimmtes Wissen (implizites Wissen) fehlt, auch zugehöriges Können nicht vorhanden ist. [4] Bei einer idealen Prüfung wählt der Prüfende daher einen Prüfungstyp, der dem jeweiligen Professionalisierungsgrad entspricht. Für Hochschulen bedeutet dies, dass die Möglichkeiten für den Einsatz elektronischer Prüfungen davon abhängen, wie praxisorientiert sie ausbildet.

Kritische Betrachtung

Vorteile und Mehrwerte

- Multimediale Elemente integrierbar (Audio, Video, Animation)

- Antworten sind besser lesbar (aber abhängig von der Tippgeschwindigkeit)

- Mischen von Fragen/Antworten nach Zufallsprinzip erschwert Täuschungen

- (Teil-)automatisierte Auswertung spart Korrekturzeit (setzt aber korrekte Antworten voraus)

- Mehr Auswertungsobjektivität, weniger subjektive Einflüsse

- Vergleich von Leistungen ist einfacher/übersichtlicher

- Qualität von Fragen leichter zu untersuchen (Item-Analyse)

- Übertragung von Ergebnissen (z.B. in Prüfungsverwaltungssysteme) weniger fehleranfällig

- Stufenförmige & adaptive Prüfungsverläufe sind modellier- und realisierbar

- Fragepools wiederverwendbar & austauschbar (z.B. Lehrverbund, Weiterentwicklung bzw. Ausbau denkbar)

- Antworten beliebig oft (spurlos) durch Prüflinge änderbar

- Prüfung mit Ergebnissen ist digital archivierbar

Nachteile und Herausforderungen

- Umfangreiche Vorarbeiten sind nötig (Fragepools erstellen, etc.)

- Hohe Kosten/Investitionen für den Aufbau von Testcentern, Prüfungsräumen, etc.

- Im Falle von Outsourcing: völlige Abhängigkeit von Full-Service-Anbietern

- Anfälligkeit für Pannen, keine 100%-ige Zuverlässigkeit (z.B. bei Stromausfall)

- Unterschiedliche Kenntnisstände (von Prüflingen und Prüfern) beim Umgang mit IKT, Schulungen und Probeklausuren notwendig

- Neue Manipulationsformen erfordern zusätzliche Sicherheitskonzepte (Chat, USB-, Netzzugriff, etc.)

- Unzureichende Flexibilität der Prüfungsordnungen

- Hoher Aufwand zur Herstellung von Rechtssicherheit

- Geforderte langjährige Archivierung fraglich (Träger?)

- Einziger Standard (IMS QTI) wird kaum unterstützt

- Automatische Auswertung nicht überall sinnvoll/geeignet

- System soll „Mitwachsen“ mit steigenden Anforderungen bzw. hochschul- und fachtypische Anforderungen erfüllen

Charakteristika elektronischer Prüfungen

Um elektronische Prüfungen didaktisch sinnvoll in die Hochschullehre zu integrieren, sollte sich ein Lehrender bereits im Vorfeld Gedanken über die Art und Weise ihres Einsatzes machen. Je nach Ziel und Zweck kann sie unterschiedlich ausgestaltet sein.

- Zweck: Zunächst muss der Lehrende den Zweck einer Leistungsmessung bestimmen. Ist z.B. Sachkompetenz festzustellen, kann es reichen, die Ergebnisse der gestellten Aufgaben zu erfassen und auszuwerten. Bei Methodenkompetenz ist der Lösungsweg zu analysieren, der bei der Bearbeitung der Aufgabe gewählt wird, während bei Sozialkompetenz eher das Verhalten und die Kommunikation der Prüflinge untereinander im Vordergrund steht.

- Art: Summative Prüfungen überprüfen den Lernerfolg im Anschluss an einen Lernprozess, während formative Prüfungen den Lernprozess begleiten und dabei helfen, ihn in eine erfolgreiche Richtung zu lenken. Diagnostische Prüfungen geben eine starre Schablone vor, in die sich die Prüflinge durch ihre Leistungen einordnen, so dass der Prüfende sie vergleichend beurteilen kann. Adaptive Prüfungen hingegen passen Schwierigkeitsgrad und Themen an Prüflinge an, um Fähigkeiten oder Schwachstellen individuell einzugrenzen. Bei prognostischen Prüfungen korreliert das Testergebnis mit dem zu erwartenden Leistungsniveau der Prüflinge; sie finden z.B. als Zulassungstests Anwendung.

- Form: Die Form einer Prüfung richtet sich nach dem jeweils erreichten Kompetenzgrad. Auf der Ebene der Fakten und Konzepte geht es darum, das Grundlagenwissen der Prüflinge zu bestimmen, z.B. mit Multiple-Choice-Aufgaben. Eine Gegenüberstellung, welche Fragetypen sich hier für welche Lernziele anbieten, findet sich z.B. bei [5]. Um die Anwendung von Fakten und damit die Problemlösefähigkeiten der Prüflinge zu testen, bieten sich situationsbezogene Prüfungen oder Fallbeispiele an. Sollen Prüflinge hingegen erlernte Fertigkeiten zeigen, können sie dies z.B. in Simulatoren, virtuellen Laboren oder den OSCEs machen. Schließlich helfen begleitende Messungen, z.B. als Black Boxes, bei der Analyse alltäglicher Abläufe in der Praxis.

- Prüfender: Abhängig davon, wer die Beurteilung vornehmen soll, müssen unterschiedliche Voraussetzungen geschaffen sein. So kann ein Lehrender im Rahmen traditioneller Bewertung (Teacher Assessment) korrekte Antworten vorgeben und so zu einer automatisierten Auswertung beitragen. Sollen sich Prüflinge hingegen selbst einschätzen (Self Assessment), wie es z.B. mit Lernfortschrittskontrollen in reinen E-Learning-Einheiten üblich ist, erscheint es sinnvoll, Lösungswege oder zusätzliche Hinweise als Feedback zu hinterlegen. Eine Auswertung von Eingaben durch andere Prüflinge oder Gruppen (Peer/Group Assessment) setzt zudem Kriterienkataloge voraus, an denen sich diese zur Bewertung orientieren können. Auf diese Weise verschmelzen die Lernenden nach [6] stärker mit dem Lernprozess, was sich positiv auf den Lernerfolg auswirken kann.

- Ort: Prüfungen auf dem Campus, z.B. in einer Veranstaltung, sind i.d.R. anders gestaltet als Prüfungen, die Prüflinge zu Hause ablegen. Zudem ist von Bedeutung, ob eine Prüfung beaufsichtigt sein muss, weil z.B. Täuschungen erschwert werden sollen, oder ob sie der Übung oder Beschäftigung mit dem Thema dient und an beliebigen Orten abgewickelt werden kann. Feste Prüfungen setzen fest installierte Arbeitsplätze voraus, z.B. ein Testcenter wie es die Uni Bremen einsetzt. Für mobile Prüfungen kann man z.B. einen Hörsaal mit Tablet-PCs oder Clickern ausstatten, auf dem die Teilnehmer ihre Eingaben vornehmen.

- Zeit: Neben dem Ort spielt auch die Zeit eine wesentliche Rolle. Abhängig vom Typ der Prüfung (formativ/summativ) ist zu entscheiden, ob einmalig oder kontinuierlich geprüft werden soll. Auch summative Prüfungen können kontinuierlich erfolgen, z.B. wenn im Rahmen eines Moduls mehrere Klausuren oder Tests vorgesehen sind.

- Bewertung: Die Auswertung von Eingaben kann abhängig von den ausgewählten Fragetypen manuell oder (teil-)automatisiert stattfinden. Eine Beurteilung der Ergebnisse liegt dann im didaktischen Ermessen des Lehrenden, insofern nicht in einer Ordnung oder Moduldeskriptor anders vorgeschrieben. Von traditionellen Formen bin zum „confidence-based marking“[7] sind verschiedene Methoden der Bewertung vorstellbar. Im letzteren Fall gibt der Prüfling neben jeder Antwort noch an, wie sicher er sich seiner Antwort ist (von unsicher/geraten bis sehr sicher). Damit sind Rückschlüsse auf das Zutrauen ins eigene Wissen sowie auf Fehler im Lernprozess möglich, die dann z.B. im formativen Fall in den weiteren Lernprozess einfließen können.

- Feedback: Schließlich ist festzulegen, welche Rückmeldung die Prüflinge erhalten sollen. Feedback kann schriftlich erfolgen oder in einem Gespräch mit dem Bewertenden. Darüber hinaus ist zu überlegen, wie detailliert das Feedback sein muss. Die Reichweite reicht von einem „hat bestanden“ bis hin zu einer detaillierten Analyse von Schwachstellen mit einer individuellen Beratung. Ein solches Feedback kann z.B. direkt im Anschluss an die Abgabe oder erst nach abschließender Qualitätskontrolle durch den Lehrenden erfolgen (der dann vielleicht noch den Notenspiegel aufgrund der per Itemanalyse ermittelten Frageschwierigkeiten anpassen kann). Der Lehrende erhält durch die Antworten und statistischen Auswertungen der Eingaben ebenfalls ein Feedback, was besonders gut verstanden wurde und welche Inhalte vielleicht noch einmal aufgegriffen oder wiederholt werden sollten.

Abhängig von der Ausgestaltung dieser dargestellten Charakteristika sind unterschiedliche Einsatzszenarien von E-Prüfungen vorstellbar.

Linksammlung

- Dokumentation der Fachtagung E-Prüfungen (Videos, Folien) vom 22.11.2011 an der MHH

- E-Prüfungs-Blog

- Nieders. Netzwerk für E-Assessments und E-Prüfungen (N2E2)

- edu-sharing Wissenssammlung E-Prüfung/E-Assessment

- E-Assessment Anwender- u. Entwicklergruppe der ILIAS Community

- E-Assessment-Dienst (Testcenter) der Uni Bremen

- iAssess.Sax: E-Assessment an Sächsischen Hochschulen

- E-Examinations-Projekt der FU Berlin

- Themenseite zu E-Assessment bei e-teaching.org

- Mobile elektronische Prüfungen an der MH Hannover

- E-Klausur-Wiki der Uni Gießen

- E-Prüfungen bei e-teaching.org

- 9. Koblenzer E-Learning-Tag zum Thema E-Assessment (mit Videomitschnitten)

- An Hochschulen eingesetzte E-Prüfungssysteme (ZKI-Umfrage)

Literaturempfehlung

- Zentrales eLearning-Büro der Universität Hamburg (Hrsg.): eAssessment auf dem Prüfstand, Hamburger eLMAGAZIN, Ausgabe #07, Dezember 2011, Download als PDF

- Jona Florian Stieler: Validität summativer Prüfungen - Überlegungen zur Gestaltung von Klausuren, ISBN: 3-938076-36-4, Janus Presse, Bielefeld, 2011, Download als PDF

- Carsten Wolf (Hrsg.): E-Assessment, Zeitschrift für E-Learning, Lernkultur und Bildungstechnologie, Nr. 1/2010, ISSN: 1992-9579, Studienverlag, Innsbruck, 2010, Link

- Daniel Biella, Dieter Huth, Michael Striewe et al.: Organisation und Implementierung PC-gestützter Prüfungen an der Universität Duisburg-Essen, e-teaching.org, 2010, Download als PDF

- Michael Vogt, Stefan Schneider: E-Klausuren an Hochschulen: Didaktik – Technik – Systeme – Recht – Praxis, Koordinationsstelle Multimedia, JLU Gießen, 2009, Download als PDF

- Zentrales eLearning-Büro der Universität Hamburg (Hrsg.): eAssessment, ePrüfungen, ePortfolios, Hamburger eLMAGAZIN, Ausgabe #02, August 2009, Download als PDF

- Johannes Hartig, Eckhard Klieme (Hrsg.): Möglichkeiten und Voraussetzungen technologiebasierter Kompetenzdiagnostik, Bildungsforschung Band 20, Bonn/Berlin, 2007, Download als PDF

Weiterführende Informationen

- Denkbare Einsatzszenarien

- Checkliste zur Durchführung von E-Prüfungen

- Funktionsumfang ausgewählter E-Prüfungssysteme

- Verschiedene Aufgabentypen

- Literaturübersicht zum Thema

- Einführung und Ausbau von E-Prüfungen

- Qualität von E-Prüfungen

Literaturnachweise

- ↑ 1,0 1,1 Cornelia Rüdel: Was ist eAssessment?, In: eAssessment, ePrüfungen, ePortfolios, Hamburger eLMAGAZIN, Ausgabe #02, S. 22-24, Zentrales eLearning-Büro der Universität Hamburg, Hamburg, 2009, Download als PDF

- ↑ Gabi Reinmann: Bologna in Zeiten des Web 2.0 - Assessment als Gestaltungsfaktor, Arbeitsbericht Nr. 16, Universität Augsburg, 2007, Download als PDF

- ↑ 3,0 3,1 George E. Miller: The Assessment of Clinical Skills/Competence/Performance, in Academic Medicine, Ausgabe 65 (9), S. 63-67, 1990, Download als PDF (Abgerufen am 14.06.2010)

- ↑ Georg Hans Neuweg: Das Können prüfen - Plädoyer für eine andere Prüfungsdidaktik, in: GdWZ - Grundlagen der Weiterbildung, Ausgabe 12 (2001) 5, S. 202-205, Download als PDF (Abgerufen am 27.05.2010)

- ↑ Michael Vogt, Stefan Schneider: E-Klausuren an Hochschulen: Didaktik – Technik – Systeme – Recht – Praxis, Koordinationsstelle Multimedia, JLU Gießen, 2009, Download als PDF

- ↑ Christian Bogner: Studentisches Feedback im Bachelor - Eine empirische Untersuchung zur Effektivität und Qualität eines angepassten Peer-Assessment-Verfahrens, in A. Back, P. Baumgartner, G. Reinmann et al. (Hrsg): zeitschrift für e-learning - lernkultur und bildungstechnologie, ISSN: 1992-9579, Themenheft E-Assessment, S. 36-49, Studienverlag, Innsbruck, 2010

- ↑ A.R. Gardner-Medwin, M. Gahan: Formative and Summative Confidence-Based Assessment, in: Proceedings of the 7th CAA Conference, S. 147-155, Loughborough University, Loughborough, 2003, Download als PDF (Abgerufen am 15.07.2010)